Nhà Quản Lý Đang Hiểu Sai Trong Nỗ Lực Hạn Chế AI Mở

Cuộc tranh luận về chính sách trí tuệ nhân tạo (AI) hiện nay bao gồm nhiều vấn đề gây tranh cãi, trong đó có cuộc chiến lâu dài giữa hệ thống mã nguồn mở và mã nguồn đóng. Ngày nay, sự phân chia này lại nổi lên với việc các nhà lập pháp ở California và châu Âu đang cố gắng hạn chế các "mô hình AI mã trọng số mở."

Các mô hình mã trọng số mở, giống như phần mềm mã nguồn mở trước đó, là các hệ thống công khai cho phép mã nguồn cơ bản của chúng được kiểm tra và sửa đổi bởi nhiều bên khác nhau cho các mục đích khác nhau. Một số nhà phê bình cho rằng việc mở mã các mô hình hoặc hệ thống thuật toán là “đặc biệt nguy hiểm” và nên bị hạn chế. Tuy nhiên, các hạn chế quy định tùy tiện đối với hệ thống AI mã nguồn mở có thể gây ra nhiều bất lợi nghiêm trọng bằng cách hạn chế đổi mới, cạnh tranh và minh bạch.

Báo Cáo Chính Phủ

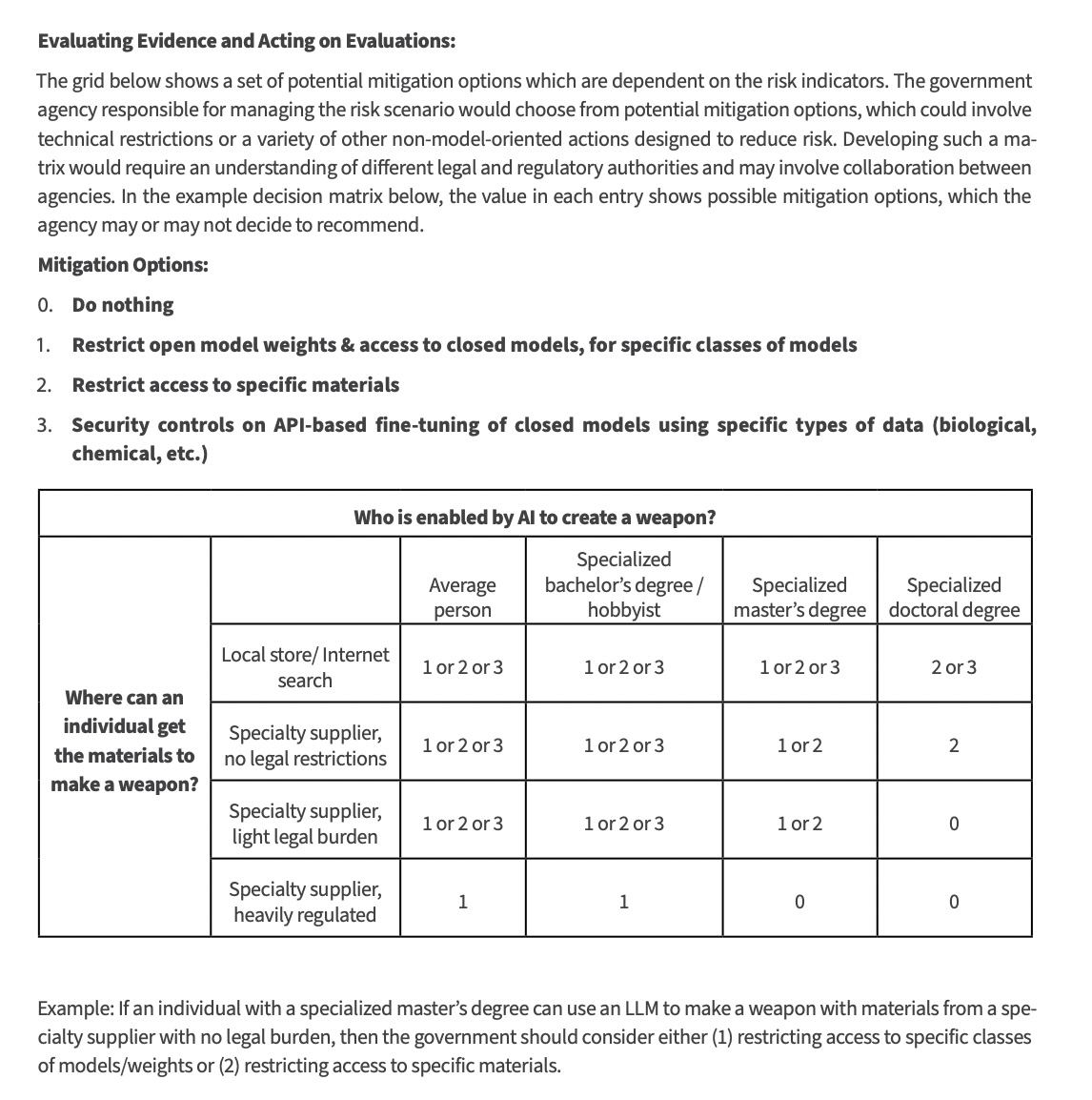

Vấn đề này trở nên nổi bật gần đây sau những thông báo quan trọng từ chính phủ và ngành công nghiệp. Đầu tiên, vào ngày 30 tháng 7, Bộ Thương mại đã phát hành một báo cáo quan trọng về các mô hình như vậy, theo yêu cầu của lệnh hành pháp về AI mà Tổng thống Joe Biden ký vào tháng Mười.

Báo cáo cuối cùng chủ yếu rất hoan nghênh các hệ thống AI mã trọng số mở và “phác thảo một con đường cẩn trọng nhưng lạc quan” cho chúng. Báo cáo kết luận rằng “không có đủ bằng chứng về các rủi ro biên của các mô hình nền tảng hai mục đích với mã mô hình rộng rãi để kết luận rằng việc hạn chế mã mô hình hiện tại là phù hợp, cũng như việc hạn chế sẽ không bao giờ phù hợp trong tương lai.”

Báo cáo này được đưa ra ngay sau tuyên bố của Ủy ban Thương mại Liên bang về các mô hình mã trọng số, nói rằng chúng “có khả năng thúc đẩy đổi mới, giảm chi phí, tăng sự lựa chọn của người tiêu dùng và nói chung có lợi cho công chúng.”

Những tuyên bố tích cực này từ chính quyền Biden cũng được J.D. Vance, ứng cử viên Phó Tổng thống của Đảng Cộng hòa, ủng hộ, người đã bày tỏ sự ủng hộ đối với AI mã nguồn mở như một cách để chống lại các ông lớn công nghệ. Điều này cho thấy có sự ủng hộ song phương đối với AI mã nguồn mở.

Sự Phát Triển Mới

Sự phát triển lớn khác là việc Meta mới đây phát hành phiên bản mới và mạnh mẽ nhất của mô hình AI “Llama 3.1.” Mark Zuckerberg, Nhà sáng lập và Giám đốc điều hành của Meta, đã thông báo phát hành cùng với một bài luận về cách “AI Mã Nguồn Mở Là Con Đường Phía Trước.” Mặc dù Llama không phải là hệ thống hoàn toàn mã nguồn mở — Meta vẫn kiểm soát mã nguồn cơ bản — mô hình này cho phép phát triển ứng dụng bổ sung trên đó. Điều này thúc đẩy đổi mới và cạnh tranh trong AI.

Tuy nhiên, ngay cả khi các nhà phát triển AI mã nguồn mở có vẻ được thông qua từ các quan chức liên bang, các nhà quản lý ở cấp bang và quốc tế khác có thể hạn chế tiềm năng của họ.

Hiện chưa rõ liệu các mô hình AI mã trọng số lớn có hợp pháp dưới cách tiếp cận quy định khắt khe của châu Âu hay không. Meta đã thông báo rằng họ sẽ không phát hành mô hình AI đa phương thức tiếp theo của mình ở Liên minh Châu Âu “do bản chất không thể dự đoán của môi trường quy định châu Âu.” Điều này theo sau thông báo tương tự vào cuối tháng Sáu từ Apple rằng họ sẽ không triển khai các tính năng AI tiên tiến ở châu Âu “do những bất ổn quy định” liên quan đến quy định công nghệ của EU.

Hậu Quả của Quy Định Quá Mức

Đây là lý do tại sao Mỹ cần tránh các cản trở quy định vội vã mà EU đã tạo ra cho các nhà đổi mới AI. Quy định quá mức của châu Âu đã tàn phá đầu tư kỹ thuật số và thành lập doanh nghiệp, để lại lục địa này hầu như không có các đối thủ công nghệ lớn cạnh tranh toàn cầu.

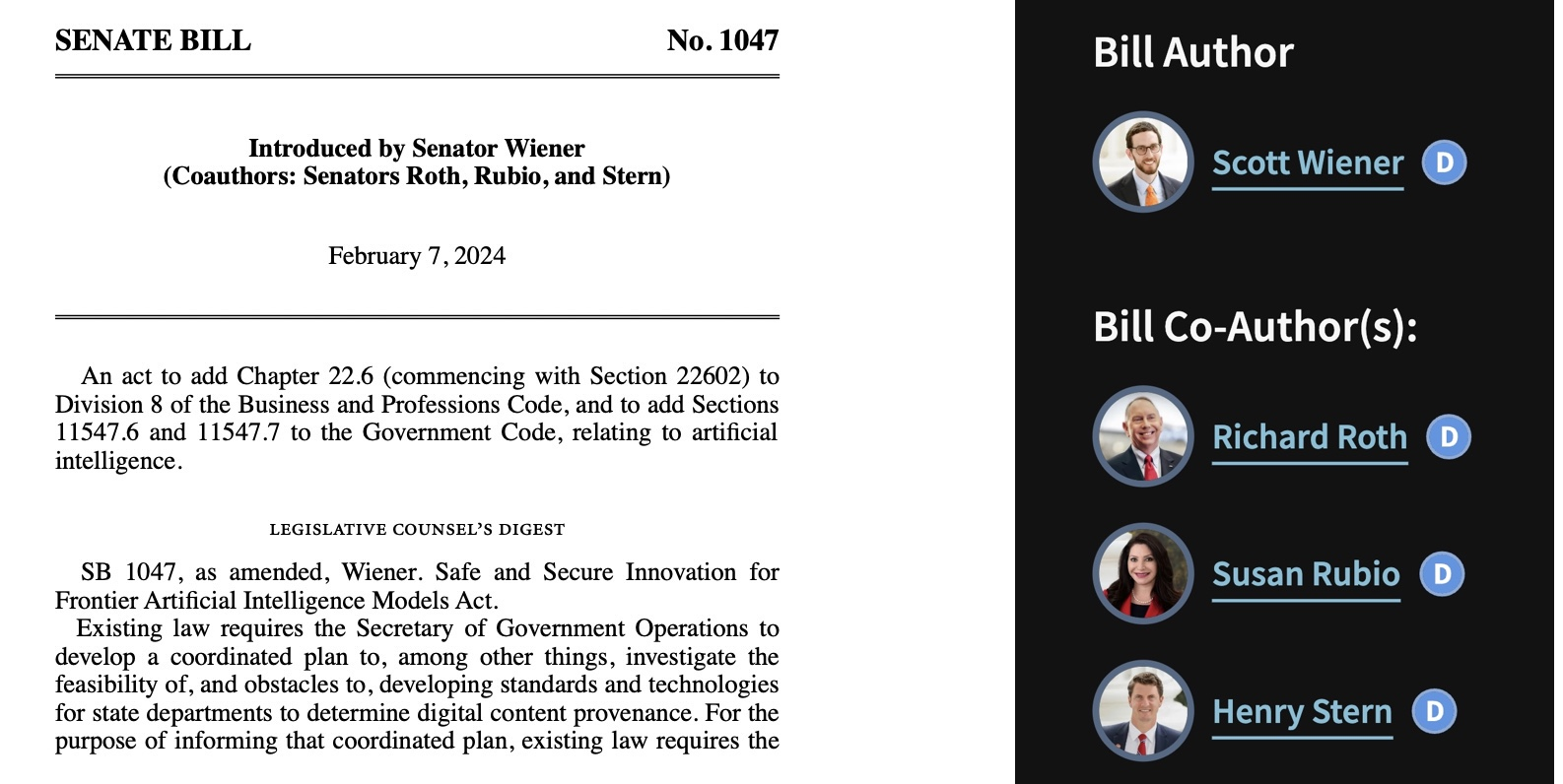

Rất tiếc, các quy định kìm hãm đổi mới như vậy có thể đang trên đường đến ở cấp bang tại Mỹ. Các nhà lập pháp Đảng Dân chủ ở California đã đề xuất Dự luật SB 1047, sẽ tạo ra một “Bộ Phận Mô Hình Tiên Phong” để thực thi nhiều quy định và hình phạt AI mới.

Dự luật sẽ yêu cầu các nhà phát triển tiên tiến cung cấp “sự đảm bảo hợp lý” rằng “các sản phẩm của mô hình không gây ra rủi ro không hợp lý đối với việc gây ra hoặc cho phép một tổn hại nghiêm trọng.” Đây là một tiêu chuẩn không thể đáp ứng đối với các nhà cung cấp mã nguồn mở, khiến các chuyên gia công nghệ cảnh báo dự luật sẽ “hạn chế nghiêm trọng các mô hình AI mã trọng số” và “kìm hãm AI mã nguồn mở và giảm an toàn.”

Điều này có vẻ nghịch lý vì những người ủng hộ luật California mô tả nó như một biện pháp an toàn AI. Tuy nhiên, nếu dự luật chặn nghiên cứu AI tiên tiến và làm suy yếu đổi mới, điều đó sẽ hạn chế các hệ thống và ứng dụng quan trọng làm tăng cường an toàn.

Tệ hơn nữa, kết quả này sẽ làm suy yếu an toàn theo một cách khác bằng cách tặng quà cho Trung Quốc, quốc gia đang tích cực thúc đẩy mục tiêu trở thành nhà lãnh đạo toàn cầu về AI vào năm 2030.

Trung Quốc đang nhanh chóng thu hẹp khoảng cách với Mỹ về đổi mới AI. Không cần phải nói, chính phủ Trung Quốc sẽ không lo lắng về việc tuân thủ những gì các quan chức California yêu cầu. Họ sẽ chỉ tiếp tục tiến lên. Như Zuckerberg của Meta đã chính xác lưu ý trong một bài đăng trên Facebook vào tháng Bảy, “việc kìm hãm đổi mới của Mỹ bằng phát triển đóng cửa làm tăng khả năng chúng ta không dẫn đầu,” vì vậy “chiến lược tốt nhất của chúng ta là xây dựng một hệ sinh thái mở mạnh mẽ.”

Sam Altman của OpenAI đã đưa ra một quan điểm tương tự trong một bài xã luận tháng Bảy, trong đó ông kêu gọi hợp tác với các quốc gia dân chủ khác để chống lại các chế độ độc tài như Trung Quốc và Nga. “Đảm bảo rằng các mô hình mã nguồn mở có sẵn cho các nhà phát triển ở các quốc gia đó sẽ củng cố lợi thế của chúng ta,” Altman viết. “Thách thức ai sẽ dẫn đầu về AI không chỉ là xuất khẩu công nghệ, mà là xuất khẩu các giá trị mà công nghệ đó bảo vệ.”

Thực sự, một cơ sở công nghệ AI mạnh mẽ và đa dạng không chỉ củng cố nền kinh tế của chúng ta và cung cấp các ứng dụng và việc làm tốt hơn, mà còn tăng cường an ninh quốc gia và cho phép các giá trị của chúng ta về chủ nghĩa đa nguyên, tự do cá nhân, quyền cá nhân và tự do ngôn luận định hình các thị trường công nghệ thông tin toàn cầu. AI mã nguồn mở sẽ đóng vai trò quan trọng trong việc thúc đẩy mục tiêu đó — miễn là các nhà lập pháp để cho nó làm vậy.